为什么你的AI Agent聊着聊着就“跑偏”了?不是模型笨,是7大机制在“作妖”!附8大架构神器,彻底治愈“老年痴呆”

你有没有过这样的经历:

和AI Agent讨论一个复杂项目,前几轮它还逻辑清晰、紧扣主题,结果聊到第10轮、20轮,它突然开始纠结一个无关紧要的细节,或者自顾自地展开一个早就偏离主线的子话题?你明明在修正,它却越“纠正”越远,最后整个对话像脱缰野马……

这不是你运气差,也不是模型“突然变笨”,而是**长对话后Agent“跑偏”**的经典症状。业内把这种现象叫做“目标漂移”或“上下文污染”,几乎所有依赖大模型的Agent系统都会遇到。

今天这篇文章,把7大核心机制和8大架构修复方案一次性讲透。看完你就能明白:不是模型不行,是架构没跟上。转发给你的AI开发者朋友,绝对能救命!

为什么长对话越聊越偏?不是单一bug,而是7大机制叠加“雪崩”

第一类:上下文污染

对话越长,历史里就塞满了“临时假设”“用户随口举例”“已经被纠正但没删干净的旧结论”。模型没有天生能力区分“核心目标”和“噪声”,于是它把次要线索当主线,越抓越紧。

第二类:目标漂移

很多Agent一开始只有一个模糊目标,每一轮只针对最近1-2条消息做“局部最优”。用户中途一提补充、修正、甚至随便岔开话题,它就顺着新线索走,完全忘记了最初的任务。短期看每句话都合理,长期看早已南辕北辙。

第三类:摘要失真

为了省上下文,很多系统把长历史压缩成summary。问题是:摘要本身就是“有损压缩”。几轮之后,原始意图被弱化,某些显眼却不重要的信息反而被放大。后面模型就像在追着“摘要的偏差”跑,而不是你的原始需求。

第四类:指令层级混杂

系统指令、工具返回、用户要求、Agent自己生成的计划……全混在一个上下文窗口里。没有角色隔离,模型很容易把“自己中间思考的结论”当成最高优先级指令。轮次越多,混杂越严重,风格、目标、甚至执着点全都变了。

第五类:错误自增强

前面某一步出现一个小小的错误假设,后续每一轮都在这个假设上继续“补全”。新输出又变成下一轮输入,偏差像滚雪球一样越滚越大——这就是闭环系统里的“误差反馈放大”。

第六类:检索与记忆策略不稳

这一轮靠短期上下文,下一轮突然切长期记忆,再下一轮又重新发明轮子。没有固定优先级,用户就感觉Agent越来越“健忘”、越来越前后不一。

第七类:工具调用后的状态回写不严谨

调用搜索、文件、日历、邮件等工具后,如果把原始结果碎片直接扔进上下文,而不是提炼成结构化信息,后续模型就容易被噪声带偏。工具越多、轮次越多,污染越严重。

一句话总结:模型不是在稳定执行任务,而是在不断续写一个越来越嘈杂、越来越有损、越来越自我引用的“烂摊子”。

真正有效的解法:别再单纯“加上下文”,改架构才是王道!

单纯把上下文窗口搞得更大,只会让污染更严重。真正的高手,都在重构Agent架构。下面8招,实测有效,建议直接抄作业:

1. 把对话历史和任务状态彻底分开

别让模型每轮都吃完整聊天记录!维护一份结构化任务状态(当前主目标、成功标准、已确认约束、已排除方案、待确认问题、最新事实)。后续每轮优先喂这份状态,而不是原始长对话。

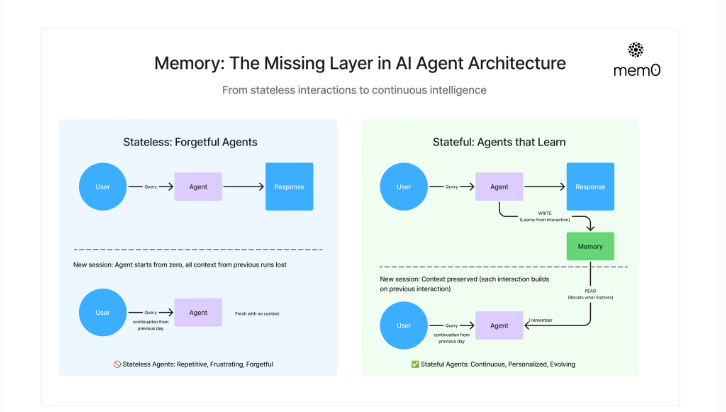

2. 采用分层记忆系统

- 短期记忆:保留最近交互细节

- 长期记忆:只存稳定事实

- 任务记忆:只存当前任务结论

三层各司其职,别一股脑全塞进一个memory。

3. 周期性“重锚定”

每隔5-10轮,让Agent内部(或输出)重建一次:

- 我现在到底在解决什么?

- 什么绝对不能做?

- 哪些结论已经100%确认?

- 下一步只做哪一件事?

这一步对抑制目标漂移,效果立竿见影。

4. 摘要必须“可校验”,拒绝自然语言自由压缩

用JSON Schema或固定字段做结构化摘要,失真率大幅下降。

5. 中间推理绝不直接写入长期事实

只有用户确认、工具验证、规则引擎判定的信息,才能进入长期状态。其他全是临时工作记忆。

6. 工具结果先“归一化”再注入

搜索结果整理成“事实表”,文件阅读结果整理成“结论+出处”,而不是原始大段文本。噪声污染直接减少80%。

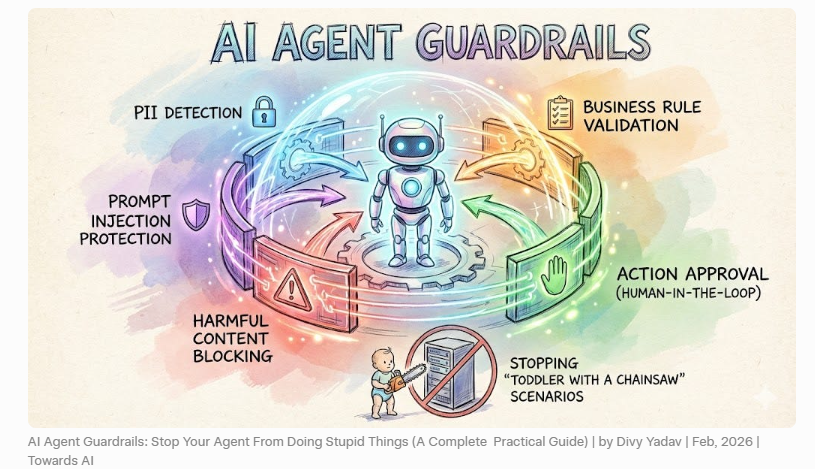

7. 增加“偏航检测”守门器

每轮结束后,轻量检查四件事:

- 当前回答是否直接服务主目标?

- 是否引入未经确认的新假设?

- 是否和已确认约束冲突?

- 是否重复已放弃的路径?

相当于给Agent装了个“自动刹车”。

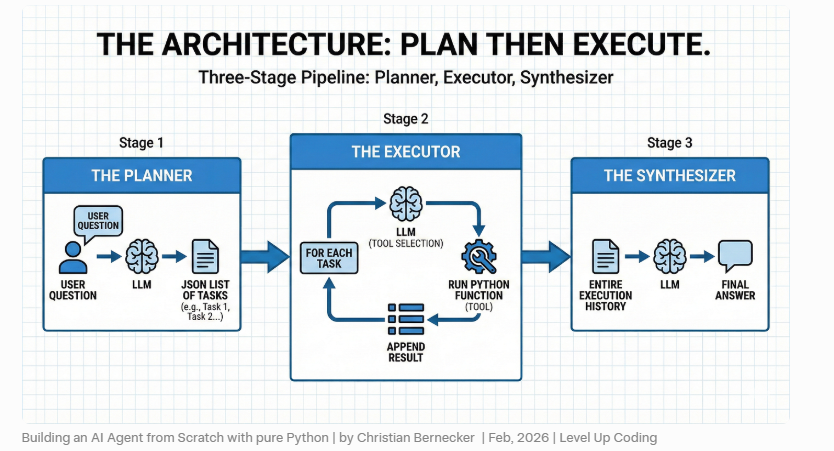

8. 长对话改为“计划-执行-校验”三段式

不再每轮自由生成:

先Plan(规划),再Execute(执行),再Verify(对齐检查)。

自由对话越长,越需要流程化约束。

最后想说

AI Agent的“跑偏”不是命运,而是架构问题。把上面这些机制改好,你会发现:同一个模型,同一个任务,长对话也能稳如老狗。

你最近的Agent有没有出现过“越聊越偏”的情况?是在第几轮开始失控的?欢迎在评论区分享你的血泪史,一起讨论最适合你场景的修复方案!

点赞+转发,让更多AI开发者少走弯路~

我们下期见,继续聊Agent的硬核架构!🚀

评论功能

当前站点为 GitHub Pages 镜像版本,不支持评论功能。

如需发表评论,请访问主域名版本:

🚀 前往 主域名 版本评论